Stable diffusionの「ControlNET&拡張機能講座」第25回目。これまでは人物に焦点を当てたものばかりでしたが、今回は背景から新たな背景を生成する「MlSD」についてです。

人物画をつくるばかりがAIイラストじゃないのニャ。

Stable diffusionをはじめたばかりのときは人物生成ばかりしますので、背景生成はあまり使うことはない気はしますね。ここにたどり着いた人は、そこそこStable diffusionを使いこなしている人とは思います。

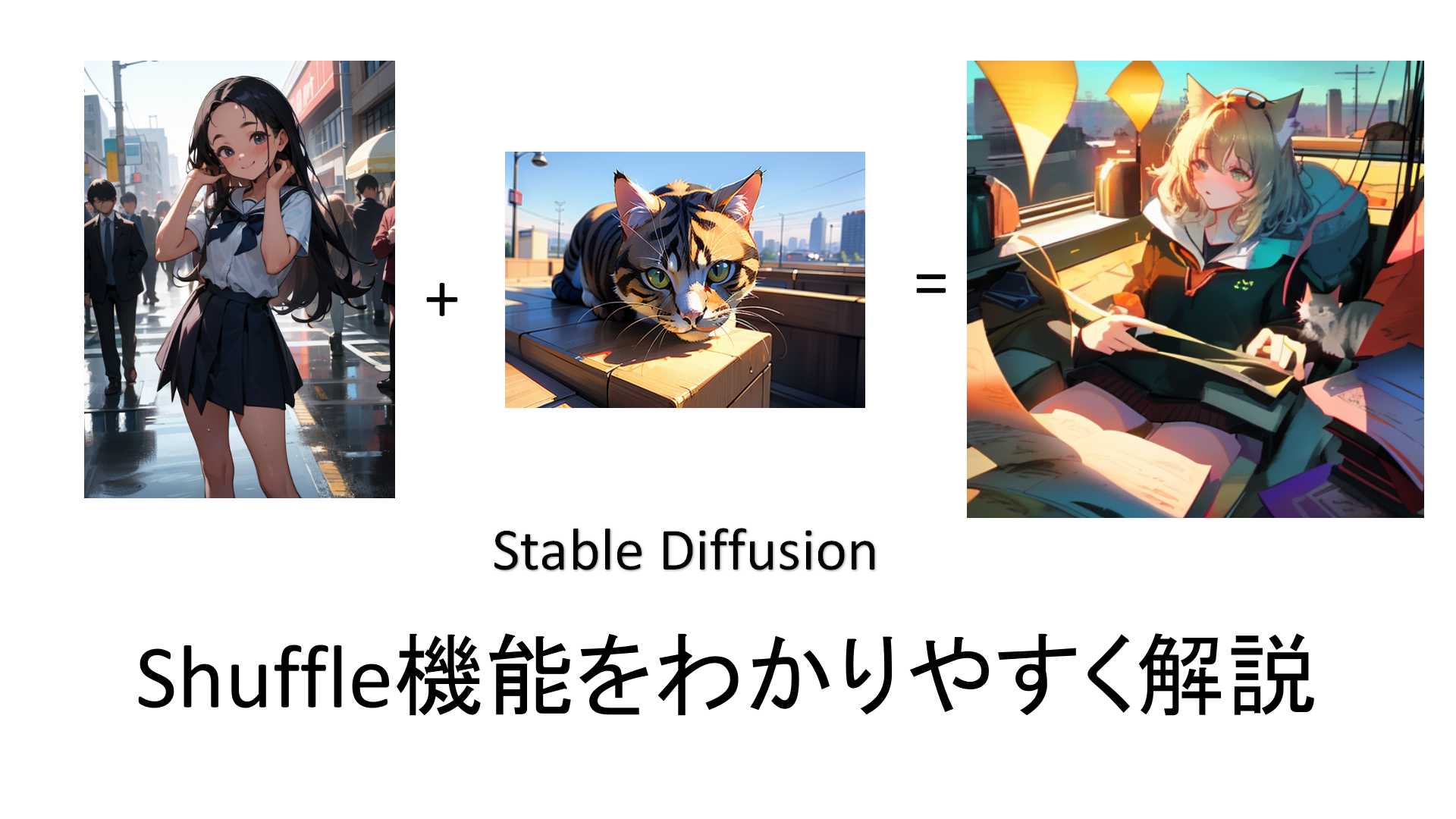

そんなわけでサクッと学んでいきましょう。前回の「お手軽にイラストを実写化する方法を発見!(逆も可能)ー「tile resample」活用テクニック」は以下のリンクから。

「MISD」の導入

「ControlNetv1.1」以上をインストールした状態であることを前提に話を進めます。まだの方や、インストールしたけどバージョンがわからんという方は以下のリンクを参照。というかここまでたどり着いた人にはいまさらかもしれませんね。

「MISD」用モデルのインストール

これもいまさらかもしれませんが、まだモデルをダウンロードしていない方は、

から、1.45Gある「control_v11p_sd15_mlsd.pth」をダウンロードします(赤い箱マークに「LFS」と書いているボタンをクリックするとダウンロード)。

ダウンロードしたものは、「Stable Diffusion」をインストールしたフォルダ内の「stable-diffusion-webui」>「models」>「ControlNet」のフォルダに入れておきます。

「MISD」の使い方

「Txt2img」でおこないます。

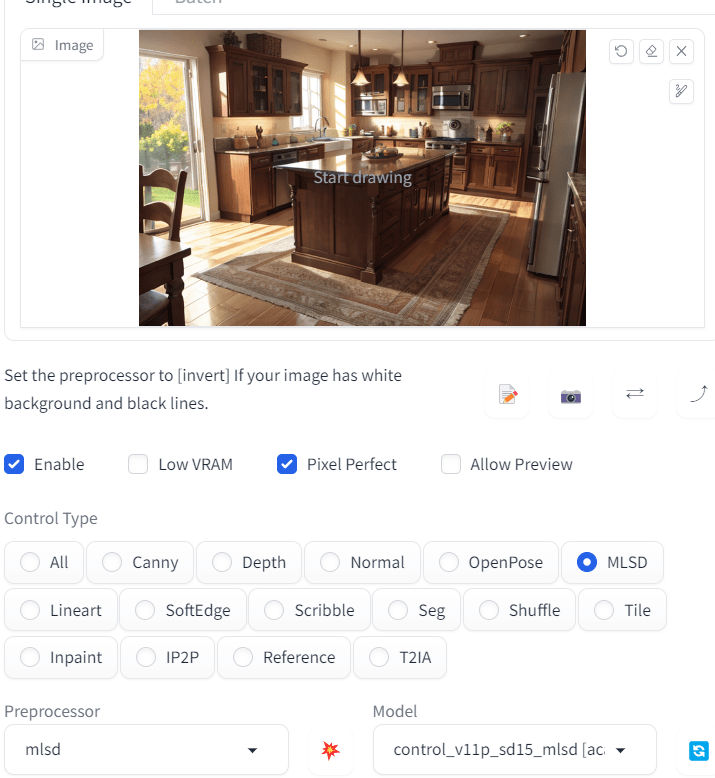

「ControlNet」を開き、「Enable」と「Pixel Perfect」にチェックを入れてください。

「Single image」にはもとになる画像を放り込みます。今回は適当に生成したキッチンの画像を利用します。

設定する「Preprocessor」は「mlsd」に、「Model」は「control_v11p_sd15_mlsd」とします。

プロンプトのほうですが、「masterpiece, best quality, highres, 4K, kitchen」など適当に書いておきましょう。「kitchen」など場所を特定できる単語を入れておいたほうがAIにわかりやすいですね。

あとは「Generate」ボタンを押して生成するだけ。

結果はタイトル画像のとおりです。

構図をそのままにして、家具が変化しているのニャ。

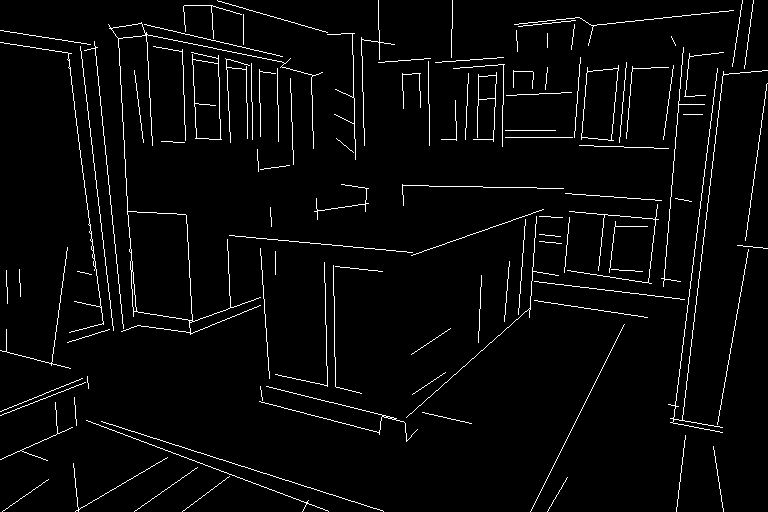

「MISD」は抽出しているのは「直線」です。それをもとにして、新たに家具を配置していく形ですね。

使い方としては、部屋や風景を写真にとって、それをイラスト化するとかにもつかえます。

背景イラストがほしいときに利用できそうニャ。

まとめ

Stable diffusion初心者はまず使わなそうな機能「MISD」ですが、応用範囲はけっこう広いと思います。

ちょっとした背景がほしいときとか、風景写真をイラスト化したいときとか、いろいろと使い道はあるでしょう。

あとは自分のつくった人物イラストに背景を組み合わせるときとかですね。

こういう基礎的な機能は、使いこなすとできることは多そうニャ。

それではまた次回の講座でお会いしましょう(作成中)。